Image générée par Google Gemini

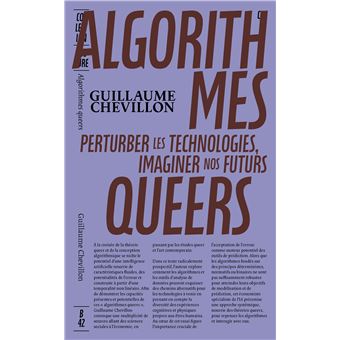

L'intelligence artificielle n'est plus une simple promesse technologique mais un moteur invisible qui modifie dès à présent nos écrits, nos décisions et, de manière croissante, nos pensées les plus profondes. Dans un nouveau livre, “Algorithmes queers”, Guillaume Chevillon, professeur de l’ESSEC et directeur académique de l’Institut Metalab pour l’Intelligence Artificielle, la donnée et la société, analyse deux questions liées : comment pouvons-nous contrôler et améliorer les effets des algorithmes à court terme et comment pouvons-nous maîtriser, voire façonner, leurs effets à long terme ?

Guillaume Chevillon est également économètre, c'est-à-dire chercheur à l’intersection des sciences sociales et de la science des données. Il constate que la conception de ces systèmes – souvent perçue comme une discipline positiviste et apolitique par son usage des mathématiques – repose en réalité sur des constructions humaines qui ne peuvent répondre d'une véritable neutralité dans leurs choix économiques et techniques. La réussite d'un algorithme est en effet mesurée par sa capacité à optimiser des critères de précision statistique pour un impact immédiat, omettant de fait trop souvent ses effets de long terme et occultant l'incertitude radicale qui caractérise l’avenir de nos sociétés. Qui aurait pu imaginer par exemple que Facebook, qui avait débuté comme un annuaire d’ancien·nes élèves, deviendrait un instrument de libération dans les “révolutions de couleur” en ex-URSS ou au cours des Printemps Arabes, mais participerait également à la polarisation et à la propagation de la désinformation dans nos sociétés démocratiques ? Si l'IA nous apporte en effet des services utiles, elle influence nos préférences et peut mener à un glissement de ce que nous percevons collectivement comme normal ou désirable.

L'échec de l'optimisation rigide : Les leçons de l'histoire économique

Cette quête de perfection prédictive à court terme rappelle les limites rencontrées par la modélisation en macroéconomie et en finance au siècle dernier. L'action pour une Banque Centrale de prévoir l’inflation et de l’annoncer modifie les anticipations individuelles et donc l'avenir lui-même : cette spécificité des sciences sociales les distingue des autres sciences. La critique dite de Lucas formalisée en 1976 par le futur prix Nobel d’économie, Robert Lucas, illustre parfaitement ce paradoxe : elle rappelle qu’aucun algorithme d’influence utilisé dans un cadre humain ne peut être certain d'obtenir le résultat prévu car il a été conçu avant que son usage ne change la donne. En effet, l'introduction d'un nouvel outil de contrôle modifie les lois de comportement de ceux qu'il prétend régir. L'expérience de la crise financière des subprimes montre également que des algorithmes conçus pour réduire les risques peuvent devenir des objets toxiques lorsqu'ils manquent de plasticité et ignorent l'inventivité humaine qui détourne les outils de leurs usages prévus.

Pour éviter que les rouages de nos organisations ne se grippent, il est essentiel de privilégier des systèmes souples et résilients, de rechercher une forme de plasticité. Le professeur Guillaume Chevillon estime que le travail des chercheur·ses qui ont développé des études et des théories queers offre un cadre d’analyse des plus pertinents pour accompagner la conception des algorithmes et de l’IA, notre interaction avec ceux-ci, ainsi que notre projection vers l’avenir. Si queer désigne à l’origine une injure adressée à l’encontre de personnes LGBTQIA+, sa réappropriation comme assertion positive a ouvert un champ de pratiques et de réflexions issues de l’expérience minoritaire. Pour Inès et Philippe Liotard[1], « queeriser serait donc transformer au sens (positif) de pervertir, de déconstruire, de décaler, d’interroger les fondements du savoir et des normes pour produire une connaissance critique, vivante, ouverte ».

Le professeur Chevillon mobilise les thèmes au cœur de l’ingénierie sociale actuelle et de ses approches alternatives : le pouvoir de prévoir et d’agir, le contrôle des narrations et donc des données, notre capacité à sortir des chemins déterministes et linéaires, notre goût pour l’expérimentation, le risque et l’erreur, notre volonté de liberté et de solidarité. Une approche queer de la conception algorithmique, entendue comme une méthodologie valorisant « le maillage ouvert des possibilités et les dissonances »,[2] permet de rendre les systèmes plus robustes. Au lieu de viser une précision rigide, l’utilisateur·ice de l’algorithme, par exemple un·e manager, doit rechercher l'antifragilité[3] en acceptant l'erreur et l'incertitude comme des éléments constitutifs de la décision, même algorithmique, afin d’éviter de générer des failles structurelles qui se révèleront par la suite.

La géopolitique de la prédiction et les nouveaux rapports de pouvoir

Un grande part du pouvoir économique se déplace de nos jours vers celles·eux qui contrôlent les moyens de prédiction, ce qui comprend entre autres les données, l'infrastructure computationnelle, l'expertise technique et l'énergie qui les sous-tendent[4]. Ces acteur·ices ne se contentent pas d'émettre des prévisions de ce qui pourrait advenir mais agissent sur leur environnement pour forcer leurs propres prédictions à se réaliser. Cette dynamique est favorisée par des situations oligopolistiques auxquelles les rendements d'échelle croissants des données et de l’IA amènent naturellement : un cercle vertueux s’installe où l’accès à davantage de données permet un meilleur entraînement des algorithmes et donc une meilleure qualité de service, amenant davantage d’utilisateur·ices et donc de données d’entraînement.

Ce processus qui s’appuie sur la force de “l’effet réseau” entre utilisateur·ices mène parfois au phénomène d'enshittification théorisé par l’essayiste Cory Doctorow [5] où la qualité d'un service est progressivement réduite par la maximisation de la rente extraite des utilisateur·ices rendu·es dépendant·es. Il est donc important de repérer les externalités négatives de l’usage de l’IA, comme la pollution sociale ou mentale générée par la polarisation des réseaux, les questions d’équité ou de renforcement de certains hiérarchies sociales préexistantes, mais surtout un trop fort tropisme déterministe où nous avons tendance à penser que nos réussites sont le fait de nos choix, voire de notre talent. C’est le “biais du survivant” qui attribue indûment un flair prophétique à des décisions dont la réussite relève parfois de la simple chance statistique.

Vers une gestion sobre et humaine des ressources

L'impact environnemental de l'IA constitue un défi stratégique majeur car la volonté de stocker une information permanente et sans erreur exige une consommation énergétique gargantuesque. À l'inverse, l'apprentissage organique de nos cerveaux accepte l'oubli et la dégradation de l'information, ce qui s'avère bien plus sobre sur le plan énergétique. Les décideur·es de demain peuvent transformer cette contrainte en avantage en adoptant une gestion sobre des données et en intégrant le droit à l'oubli ou des formes nouvelles de désapprentissage automatique[6] pour préserver la viabilité de son environnement et la robustesse des systèmes.

Dans le domaine du recrutement par exemple, cette philosophie humaine permet de s'extraire des typologies normatives qui réduisent un·e collaborateur·ice à un profil statistique abstrait. En refusant de se fier uniquement à des corrélations souvent fallacieuses, un·e recruteur·ice peut porter son attention sur les zones liminales, celles qui se situent entre les catégories normées, et les trajectoires non conformes qui sont les véritables moteurs de la créativité. Il s'agit de toujours chercher à renforcer la capacité d’action des personnes et de favoriser la comparution[7] – comprendre notre lien avec le monde à partir de ce que l’expérience de l’autre fait résonner en nous – cette forme de dépaysement où l'on se connecte à l'autre à travers les possibilités de vies non vécues qui nous constituent.

Dans le livre de Guillaume Chevillon, il s'intéresse aussi à la conception même des algorithmes et de l’IA afin de découvrir des manières de les rendre plus robustes et sécurisés. Il montre que nombre de leurs succès peuvent être reliés à des caractéristiques queers telles que i définies ci-dessus – moins déterministes et hiérarchisées et davantage exploratoires, coopératives et ouvertes à l’erreur. Ces réussites esquissent des approches sur lesquelles les concepteur·rices d’algorithmes pourraient s’appuyer afin de renforcer ces derniers. Cela leur permettrait de prévenir ainsi les blocages politiques et sociaux éventuels vers lesquels ils pourraient nous mener, mais cela implique de ne pas restreindre l’exploration de nos futurs possibles aux passés et présents qui ont été codés dans les données disponibles.

L'action collective

Nous devons aussi déterminer notre réaction vis-à-vis de l’IA, nous tous·tes qui ne possédons ni ne concevons les algorithmes, mais qui souhaitons collectivement maintenir notre capacité à définir et contrôler notre avenir ainsi que celui de nos sociétés. Guillaume Chevillon repère ainsi des exemples de comportements ou des pratiques pour interagir avec les algorithmes afin de les maîtriser et les orienter. Il peut s’agir par exemple d’un refus de coopération ou d’une absence de réaction qui nous permettent de reprendre le contrôle face à leurs stimuli.

Le développement de l’IA nous impose de nous réorganiser, en tant que société mais aussi dans l’entreprise. Le travail change en effet, et nous devons collaborer pour influencer les choix algorithmiques, former des réseaux qui ne cherchent pas l'affrontement frontal mais nous évitent de nous soumettre. Accepter certaines formes d’erreurs nous permet de sortir du bocal dans lequel l’IA a tendance à nous enfermer, et pour ce faire, nous pouvons par exemple utiliser l’absence de réaction (le “play dead” connu de nombreux animaux), l’oubli volontaire, ou le détournement des usages pour perturber les systèmes prescriptifs. En introduisant du jeu dans les engrenages technologiques, ces alliances redonnent à l'humain sa capacité d'extrapolation et d'invention.

L'engagement dans cette transformation technologique peut trouver sa force dans une forme de joie, cet accroissement du pouvoir d'affecter et d'être affecté selon Spinoza. Être joyeux n'occulte pas les défis mais fournit l'énergie nécessaire pour imaginer des futurs plus justes où la technologie accompagne nos désirs sans jamais les prédéterminer. En abordant le sérieux avec cette légèreté subversive, nous pouvons construire une route où les algorithmes servent l'autonomie et la diversité de chacun.

Références

1.Inès et Philippe Liotard, Queer, Paris, Anamosa, 2025, p. 32-33.

2. Eve Kosofsky Sedgwick, « Queer and Now », dans Eve Kosofsky Sedgwick (dir.), Tendencies, Durham, Duke University Press, 1993, p. 8.

3. Nassim Nicholas Taleb, Antifragile: Things That Gain from Disorder (New York: Random House, 2012).

4. Voir, pour cette analyse, Maximilian Kasy, The Means of Prediction, Chicago, Chicago University Press, 2025, p. 5.

5. Cory Doctorow, « The ‹Enshittification› of Tiktok », Wired Ideas, 23 janvier 2023, (en ligne) : https://www.wired.com/story/tiktok-platforms-cory-doctorow/

6. Pour des exemples récents d’applications et les problématiques associées, voir par exemple Sijia Liu et al., « Rethinking Machine Unlearning for Large Language Models », Nature Machine Intelligence, vol. 7, 2025, p. 181-194.

7. Bruno Perreau, Sphères d’injustice. Pour un universalisme minoritaire, Paris, La Découverte, 2023, p. 24, 193-194. (also published as Spheres of Injustice, The Ethical Promise of Minority Presence, MIT Press, 2025)